Flume多路复用模式把接收数据注入kafka 的同时,将数据备份到HDFS目录

迪丽瓦拉

2025-05-28 16:32:59

0次

启动hadoop、在hdfs中创建需要访问的目录

配置Hadoop的核心配置文件

core-site.xml:设置Hadoop的核心配置参数,例如NameNode的地址、数据块大小、副本数量等。示例配置如下:

fs.defaultFS hdfs://localhost:9000 hdfs-site.xml:设置HDFS(Hadoop分布式文件系统)的参数,例如数据块复制因子、NameNode的存储路径等。示例配置如下:

dfs.replication 1 dfs.namenode.name.dir /opt/hadoop-3.3.0/data/namenode dfs.datanode.data.dir /opt/hadoop-3.3.0/data/datanode mapred-site.xml:如果使用MapReduce框架,则需要配置该文件,设置JobTracker的地址等信息。示例配置如下:

mapreduce.framework.name yarn 格式化NameNode。在终端中输入以下命令:

hdfs namenode -format需要注意的是,格式化会删除所有已有的HDFS数据,所以需要谨慎执行。

配置Hadoop集群的JAVA_HOME

vim ./etc/hadoop/hadoop-env.sh#添加JAVA_HOME路径

export JAVA_HOME = /opt/jdk-8启动Hadoop集群。在终端中输入以下命令:

start-all.sh如果一切正常,Hadoop集群将启动成功

创建hdfs存储目录

hdfs dfs -mkdir -p /user/test/flumebackup查看是否有该目录

hdfs dfs -ls -R /user/2.启动zookeeper、kafka并创建主题

因为我已经做了一遍该配置,请移步至→

https://blog.csdn.net/HaveAGoodDay428/article/details/129567879

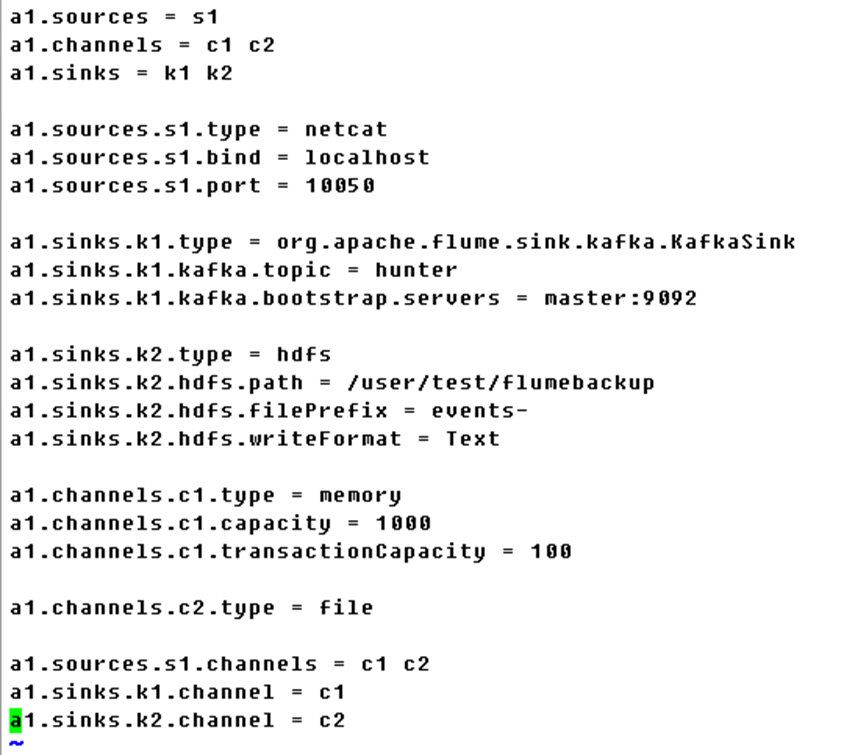

3.配置flume配置文件并启动flume

创建flume配置文件flume-kafka.conf

启动Flume

./bin/flue-ng agent -n a1 -c conf -f ./conf/flume-kafka.conf -Dflume.root.logger=INFO,console4.netcat向本地10050端口发送socket数据

nc localhost 10050可以通过查看hdfs存储目录中每次发送socket数据时是否新增文件

相关内容

热门资讯

linux入门---制作进度条

了解缓冲区 我们首先来看看下面的操作: 我们首先创建了一个文件并在这个文件里面添加了...

C++ 机房预约系统(六):学...

8、 学生模块 8.1 学生子菜单、登录和注销 实现步骤: 在Student.cpp的...

A.机器学习入门算法(三):基...

机器学习算法(三):K近邻(k-nearest neigh...

数字温湿度传感器DHT11模块...

模块实例https://blog.csdn.net/qq_38393591/article/deta...

有限元三角形单元的等效节点力

文章目录前言一、重新复习一下有限元三角形单元的理论1、三角形单元的形函数(Nÿ...

Redis 所有支持的数据结构...

Redis 是一种开源的基于键值对存储的 NoSQL 数据库,支持多种数据结构。以下是...

win下pytorch安装—c...

安装目录一、cuda安装1.1、cuda版本选择1.2、下载安装二、cudnn安装三、pytorch...

MySQL基础-多表查询

文章目录MySQL基础-多表查询一、案例及引入1、基础概念2、笛卡尔积的理解二、多表查询的分类1、等...

keil调试专题篇

调试的前提是需要连接调试器比如STLINK。 然后点击菜单或者快捷图标均可进入调试模式。 如果前面...

MATLAB | 全网最详细网...

一篇超超超长,超超超全面网络图绘制教程,本篇基本能讲清楚所有绘制要点&#...

IHome主页 - 让你的浏览...

随着互联网的发展,人们越来越离不开浏览器了。每天上班、学习、娱乐,浏览器...

TCP 协议

一、TCP 协议概念 TCP即传输控制协议(Transmission Control ...

营业执照的经营范围有哪些

营业执照的经营范围有哪些 经营范围是指企业可以从事的生产经营与服务项目,是进行公司注册...

C++ 可变体(variant...

一、可变体(variant) 基础用法 Union的问题: 无法知道当前使用的类型是什...

血压计语音芯片,电子医疗设备声...

语音电子血压计是带有语音提示功能的电子血压计,测量前至测量结果全程语音播报...

MySQL OCP888题解0...

文章目录1、原题1.1、英文原题1.2、答案2、题目解析2.1、题干解析2.2、选项解析3、知识点3...

【2023-Pytorch-检...

(肆十二想说的一些话)Yolo这个系列我们已经更新了大概一年的时间,现在基本的流程也走走通了,包含数...

实战项目:保险行业用户分类

这里写目录标题1、项目介绍1.1 行业背景1.2 数据介绍2、代码实现导入数据探索数据处理列标签名异...

记录--我在前端干工地(thr...

这里给大家分享我在网上总结出来的一些知识,希望对大家有所帮助 前段时间接触了Th...

43 openEuler搭建A...

文章目录43 openEuler搭建Apache服务器-配置文件说明和管理模块43.1 配置文件说明...